Você conhece aquela sensação horrível de perceber que um bug passou pelo code review e chegou em produção? Já passei por isso mais vezes do que gostaria de admitir. Em 2025, algo mudou — 84% dos devs adotaram ferramentas de IA pra código, mas aí vem o detalhe: 46% dos devs desconfiam ativamente da precisão do output de IA. Estamos gerando código mais rápido do que nunca, mas a capacidade de revisão não acompanhou. No início de 2026, 41% dos commits são assistidos por IA — o que significa que a diferença entre o que fazemos deploy e o que conseguimos verificar direito está crescendo rápido.

É aqui que as ferramentas de IA pra code review entram — não pra substituir o julgamento humano, mas pra cuidar do trabalho mecânico pra que a gente possa focar no que realmente importa: arquitetura, lógica e os bugs sutis que custam dinheiro de verdade.

Por que code review com IA?

Vou ser direto: code review manual não está dando conta. Times que usam IA pra code review reduzem o tempo gasto em revisões em 40-60% e melhoram as taxas de detecção de defeitos. Isso não é papo de marketing — são times de engenharia fazendo deploy mais rápido sem abrir mão da qualidade.

O que mudou no último ano: code review com IA saiu de "seria bom ter" pra infraestrutura essencial. Quando você está gerando centenas de linhas de código com assistência de IA, não dá pra depender só dos engenheiros sênior pra pegar cada edge case, cada erro de off-by-one, cada possível falha de segurança. As ferramentas de revisão com IA pegam o que os humanos deixam passar quando estão cansados, com pressa ou trocando de contexto entre cinco PRs diferentes.

O valor real? Consistência. Um revisor de IA não se cansa. Não pula as partes chatas. Aplica os mesmos padrões pra cada linha de código, sempre.

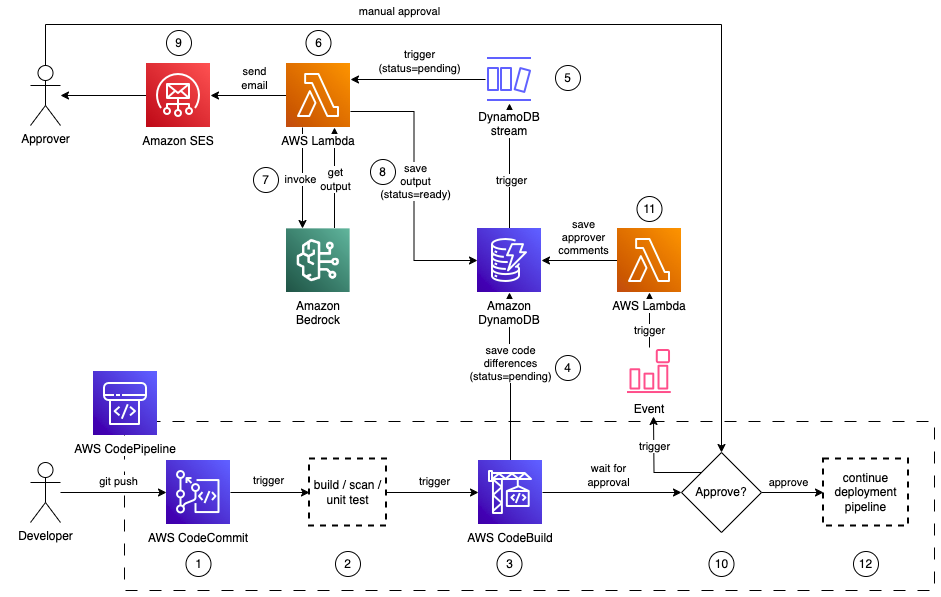

Como as ferramentas de revisão com IA funcionam

A maioria combina três capacidades principais:

Análise estática — Escaneia o código sem executá-lo, identificando erros de sintaxe, variáveis indefinidas e código inacessível antes do runtime.

Reconhecimento de padrões — Usa machine learning treinado em milhões de linhas de código pra identificar padrões comuns de bugs, vulnerabilidades de segurança e problemas de manutenibilidade.

Entendimento contextual — As boas não analisam só diffs isolados. Entendem seu codebase inteiro, dependências e como as mudanças se propagam entre serviços.

Checagem rápida de realidade: nem todas as ferramentas de revisão com IA são iguais. Algumas só apontam problemas básicos de linting — que você provavelmente já tem cobertos. As ferramentas que valem seu tempo fornecem feedback context-aware que entende o que seu código está tentando fazer, não só o que ele diz.

Principais ferramentas de code review com IA

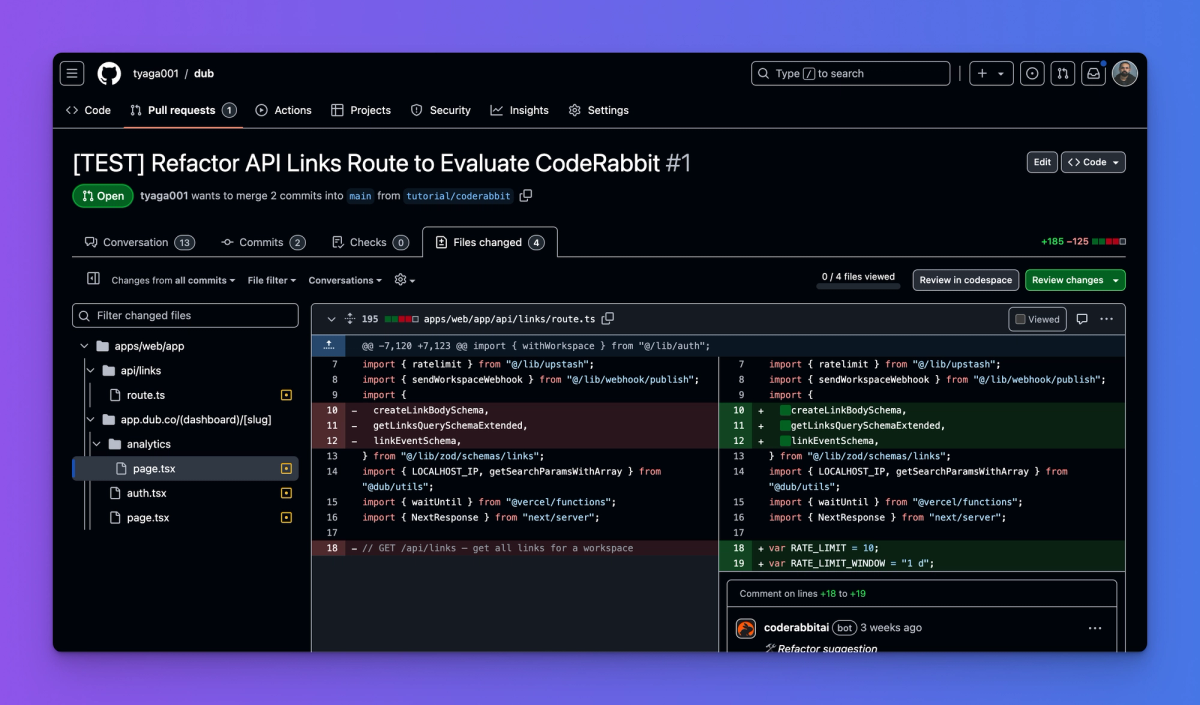

CodeRabbit

O CodeRabbit se tornou o app de IA mais instalado no GitHub e GitLab — depois de usar em alguns repos em produção, entendo o porquê. Ele gera feedback estruturado em cada pull request: legibilidade, manutenibilidade, segurança, bugs potenciais. A ferramenta atinge 46% de precisão na detecção de bugs de runtime do mundo real através de uma análise multicamada que combina avaliação de Abstract Syntax Tree, SAST e feedback generativo de IA.

O que se destacou: o CodeRabbit pega off-by-ones, edge cases e até falhas de spec e segurança antes de chegarem em produção. Um usuário mencionou que ele "enforced a more precise UUID check and saved us from a production issue." Esse tipo de catch se paga imediatamente.

Preços: Grátis pra projetos open-source. Planos pagos começam em $12/mês por dev (Lite) e $24/mês por dev (Pro). Trial grátis de 14 dias sem cartão.

Integração: GitHub, GitLab e extensão pra VS Code pra revisão local antes do push.

Melhor pra: Times que querem análise completa de PR com configuração mínima.

Lucas: CodeRabbit foi o primeiro que recomendei pra um cliente depois que um bug passou por três revisões humanas e chegou em produção. Ele teria pegado na hora.

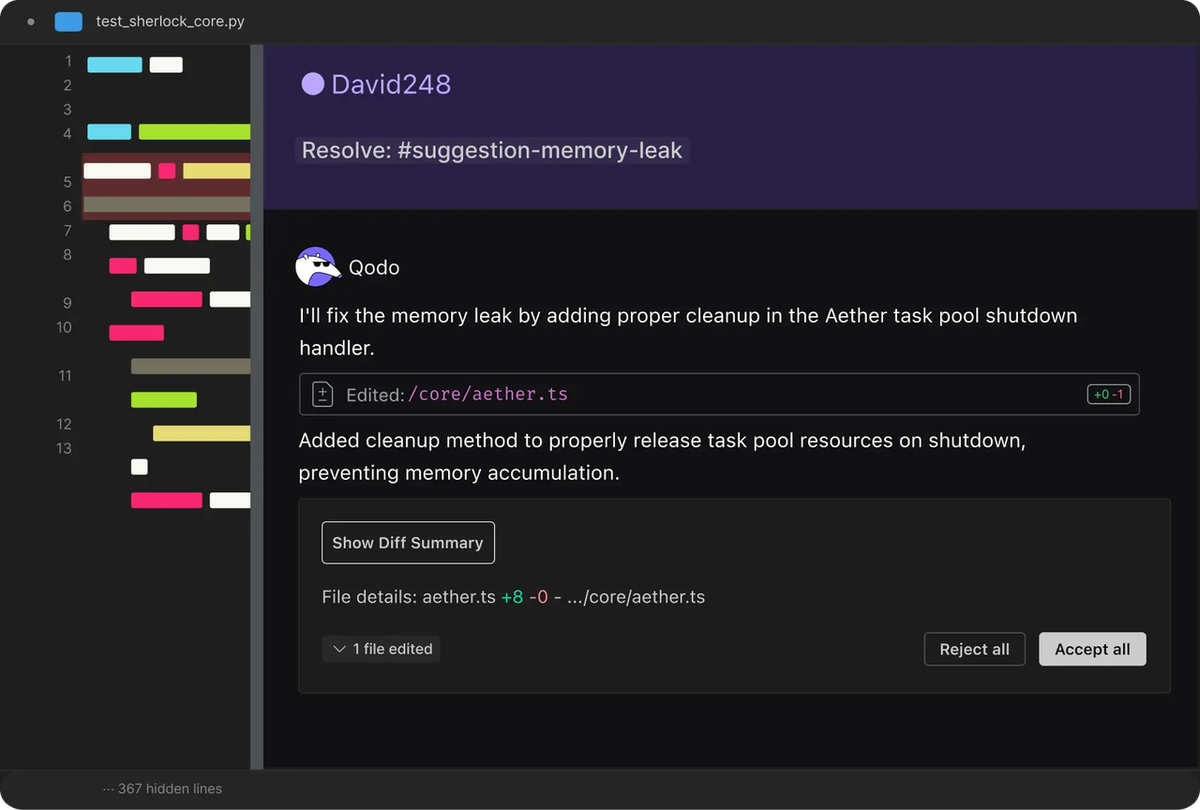

Qodo Merge

O Qodo tem uma abordagem diferente — foi construído especificamente pra code review em escala enterprise, não como feature secundária de geração de código. Conforme detalhado no site oficial do Qodo, a plataforma economizou mais de 450.000 horas de dev em um ano num varejista Global Fortune 100, com devs economizando cerca de 50 horas por mês cada.

O que faz diferença: o Qodo indexa seu codebase inteiro — 10 repos ou 1000 — e entende o grafo de dependências. Quando você muda uma biblioteca compartilhada, ele aponta quais serviços são afetados. Não é análise de diff; é revisão com consciência de sistema.

A plataforma roda 15+ workflows agênticos automatizados que cuidam de detecção de bugs, verificação de cobertura de testes, atualizações de documentação e manutenção de changelog. Não está só apontando problemas — está automatizando o pipeline de revisão inteiro.

Preços: Grátis pra devs individuais (75 PRs + 250 créditos LLM/mês). Plano Teams a $30/usuário/mês. Enterprise começa em $45/usuário/mês com SSO e opções on-prem.

Integração: GitHub, GitLab, Bitbucket, VS Code, JetBrains IDEs, CLI.

Melhor pra: Grandes organizações de engenharia com ambientes multi-repo e dependências complexas.

Lucas: Pra projetos com múltiplos repos interdependentes, o Qodo é numa categoria diferente. Nenhuma outra ferramenta entende o grafo de dependências da mesma forma.

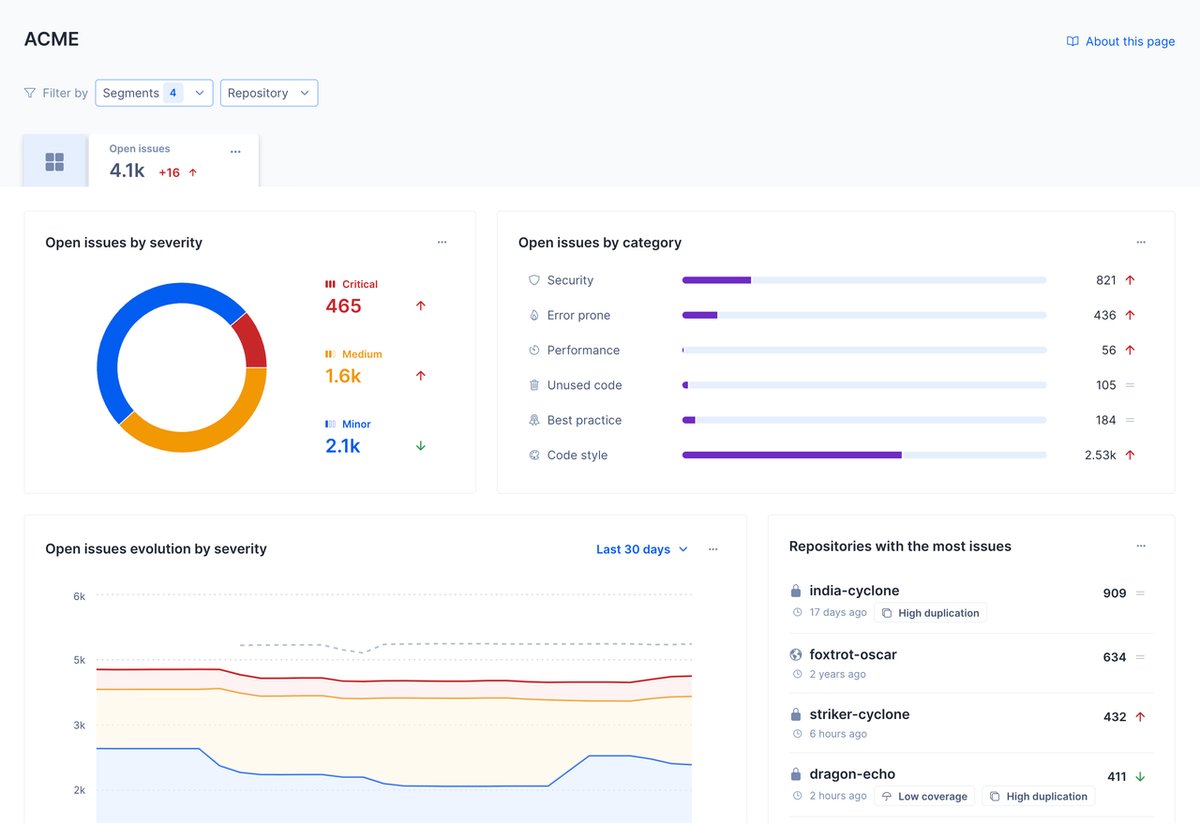

Codacy

O Codacy foca em qualidade de código e segurança automatizadas. Pega problemas como duplicação de código, complexidade e vulnerabilidades de segurança antes de chegarem na sua branch principal. O que aprecio no Codacy é o suporte out-of-the-box pra 40+ linguagens de programação e padrões.

A plataforma fornece quality gates que podem bloquear merges se o código não atender aos seus padrões. Isso é enorme pra times tentando manter qualidade consistente em codebases grandes.

Integração: GitHub, GitLab, Bitbucket.

Melhor pra: Times que precisam de scanning de segurança abrangente e enforcement de qualidade.

Lucas: Quality gates que bloqueiam merge automaticamente parecem chato até você evitar o primeiro deploy problemático por causa deles.

Greptile

O Greptile é mais novo no mercado, mas vale acompanhar. Foi projetado pra entender seu codebase como um todo, não só arquivos individuais. A ferramenta se destaca em explicar mudanças de código complexas e identificar impacto arquitetural.

Melhor pra: Times que querem entendimento mais profundo do codebase e análise arquitetural.

Lucas: Ainda explorando o Greptile em projetos maiores, mas a proposta de entender impacto arquitetural de verdade é exatamente o que falta na maioria das ferramentas.

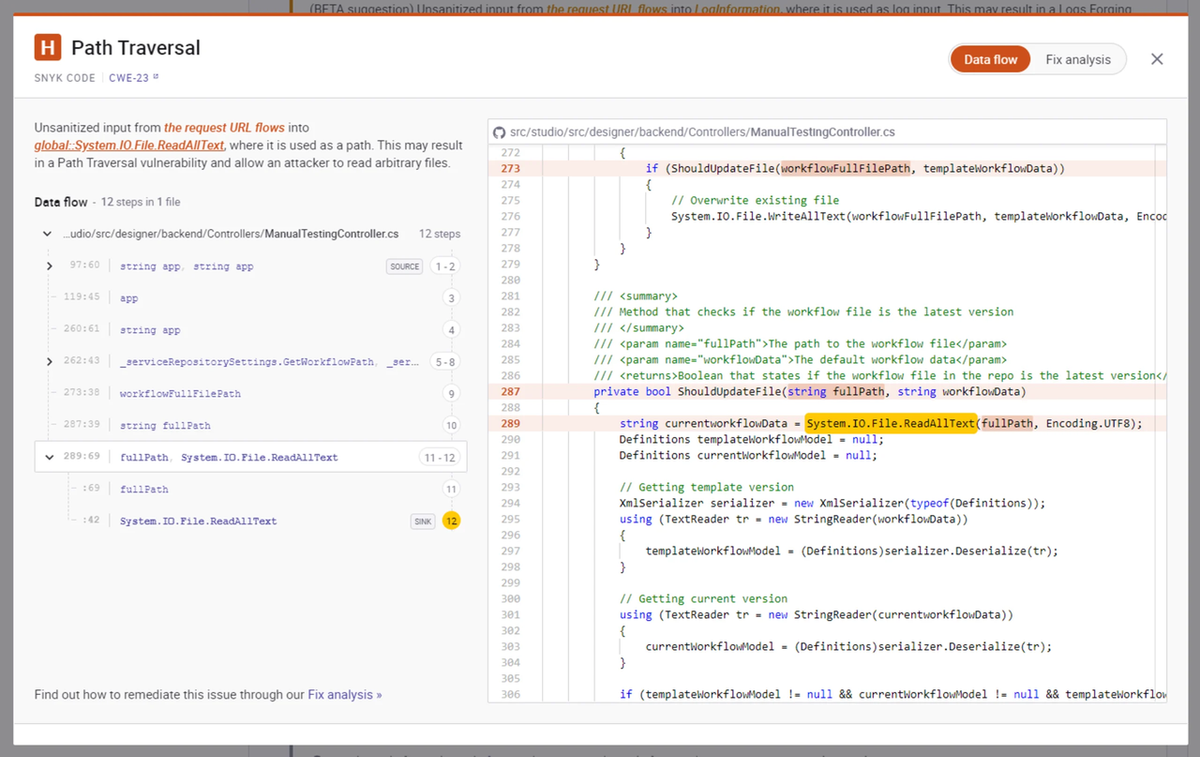

Snyk Code

O Snyk começou em segurança mas agora cobre qualidade de código mais ampla. É particularmente forte em identificar vulnerabilidades de segurança e problemas de conformidade de licenças. Se você está num setor regulado ou simplesmente leva segurança a sério, o Snyk merece atenção.

Integração: GitHub, GitLab, Bitbucket, Azure DevOps.

Melhor pra: Times focados em segurança e setores regulados.

Lucas: Pra clientes fintech e healthtech, o Snyk virou obrigatório. Compliance não é opcional nesses mercados.

Cursor Bugbot

Parte do ecossistema do Cursor IDE, o Bugbot fornece feedback de revisão em tempo real enquanto você codifica. É menos sobre revisão de PR e mais sobre pegar problemas antes mesmo de você fazer commit.

Melhor pra: Devs que querem orientação de revisão dentro do editor.

Lucas: Shift-left de verdade — pegar o bug no momento em que você escreve, não depois que o PR já está aberto.

Tabela comparativa

| Ferramenta | Tier grátis | Preço base | Enterprise | Melhor pra |

|---|---|---|---|---|

| CodeRabbit | Sim (open-source) | $12/mês (Lite) | Sob consulta | Análise completa de PR |

| Qodo Merge | Sim (75 PRs/mês) | $30/mês (Teams) | $45/mês | Multi-repo, enterprise |

| Codacy | Sim | Sob consulta | Sob consulta | Segurança + qualidade |

| Greptile | Sim | Sob consulta | Sob consulta | Análise arquitetural |

| Snyk Code | Sim | Sob consulta | Sob consulta | Segurança, compliance |

| Cursor Bugbot | Sim (Cursor) | Incluso no Cursor | — | Revisão in-editor |

Opções de integração

GitHub

A maioria das ferramentas integra com GitHub via GitHub Apps ou Actions. O CodeRabbit integra diretamente com repositórios GitHub, fazendo revisões contínuas e incrementais pra cada commit dentro de um pull request. A configuração geralmente leva 2 cliques: instala o app, concede acesso ao repo, pronto.

O que verificar: a ferramenta comenta diretamente nos PRs? Consegue corrigir issues automaticamente? Integra com seu pipeline de CI/CD existente?

GitLab

Suporte a GitLab é quase universal agora. Qodo e CodeRabbit oferecem integração de primeira linha com revisões de merge request.

Bitbucket

Suporte a Bitbucket é menos comum, mas disponível em ferramentas focadas em enterprise como Qodo e Codacy.

Comparação de preços

A demanda por ferramentas de IA pra code review cresceu 35% nos últimos três anos. Conforme a adoção cresce, os modelos de preço se padronizaram em torno de assinaturas por dev/mês.

Tiers grátis:

- CodeRabbit: grátis pra open-source

- Qodo: grátis pra devs individuais (75 PRs/mês)

Planos team ($10–30/dev/mês):

- CodeRabbit Lite: $12/mês

- CodeRabbit Pro: $24/mês

- Qodo Teams: $30/mês

Enterprise ($30–60+/dev/mês):

- Qodo Enterprise: $45/mês (inclui SSO, on-prem)

- Planos enterprise customizados com SLAs

Conta rápida: se uma ferramenta economiza 10 horas/mês de revisão por dev, e seus devs custam $100/hora, isso é $1.000/mês em valor. Uma ferramenta de $30/mês se paga 30 vezes.

Como escolher

Começa aqui: qual é sua maior dor?

Se backlog de PRs está te matando: testa CodeRabbit ou Qodo. Ambos se destacam em reduzir tempo de revisão.

Se você está preocupado com quebras entre repos: a análise multi-repo do Qodo não tem igual.

Se segurança é sua principal preocupação: Snyk Code ou Codacy.

Se você quer pegar problemas antes do commit: Cursor Bugbot ou a integração de IDE do Qodo.

Não complica a avaliação. Escolhe uma ferramenta, roda em um projeto real por 2-4 semanas e mede:

- Quantos problemas reais ela pegou?

- Quanto tempo economizou?

- Quantos falsos positivos você teve?

A maioria dos times começa com um trial grátis, testa em 2-3 repos e decide com base em resultados reais, não em listas de features.

FAQ

P: IA pra code review vai substituir os revisores humanos? Nem perto. Capacidade de revisão, não velocidade de implementação, determina a velocidade segura de entrega. IA cuida das verificações mecânicas — sintaxe, padrões comuns, scans de segurança. Humanos cuidam das decisões de design, trade-offs arquiteturais e validação de lógica de negócio.

P: Qual é a precisão das ferramentas de revisão com IA? Varia. O CodeRabbit atinge 46% de precisão em bugs de runtime do mundo real. Segundo o DORA 2025 State of AI-Assisted Software Development Report, times de alta performance usando code review com IA têm melhoria de 42-48% na precisão de detecção de bugs. É significativamente melhor do que humanos em verificações mecânicas, mas não espere perfeição. O objetivo é pegar mais bugs, não todos os bugs.

P: Essas ferramentas atrasam os pipelines de CI/CD? Ferramentas modernas rodam de forma assíncrona e não bloqueiam seu pipeline. As revisões do CodeRabbit acontecem em paralelo com seu CI existente. O Qodo pode ser configurado pra rodar só em eventos específicos.

P: E a segurança dos dados? Ferramentas respeitáveis têm certificação SOC 2 e conformidade com GDPR. O CodeRabbit usa criptografia end-to-end com zero retenção de dados pós-revisão. O Qodo oferece deploy on-prem pra enterprises. Sempre verifique a política de dados antes de adotar.

P: Posso usar múltiplas ferramentas de revisão com IA juntas? Sim, mas atenção ao ruído. Alguns times rodam uma ferramenta leve como CodeRabbit pra todos os PRs, depois usam Snyk Code pra mudanças críticas de segurança.

P: Como essas ferramentas se comparam às ferramentas tradicionais de análise estática? Ferramentas tradicionais (como SonarQube) são baseadas em regras e pegam padrões conhecidos. Ferramentas de IA entendem contexto e conseguem identificar problemas que não correspondem a regras existentes. Melhor prática: use ambas.